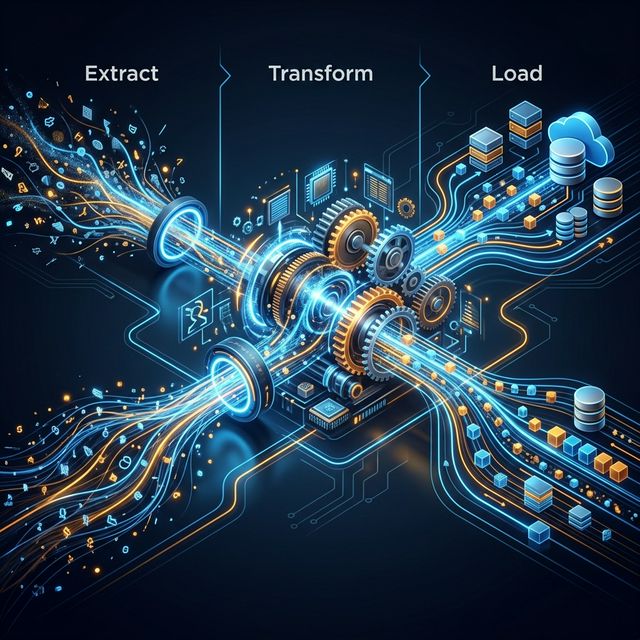

ETL-Prozesse erklärt: Extract, Transform, Load

Wie ETL-Prozesse Daten aus verschiedenen Quellen in ein Data Warehouse überführen – und warum ELT in der Cloud die bessere Wahl sein kann.

Die drei Schritte im Detail

Extract (Extrahieren)

Daten aus den Quellsystemen lesen: SQL-Datenbanken, REST-APIs, CSV/Excel-Dateien, SaaS-Plattformen (Salesforce, HubSpot), ERP-Systeme (SAP, Microsoft Dynamics). Dabei wird entweder ein Full Load (alle Daten) oder ein Incremental Load (nur Änderungen seit dem letzten Lauf) durchgeführt.

Transform (Transformieren)

Die extrahierten Rohdaten bereinigen und in ein einheitliches Format bringen: Datentyp-Konvertierungen, Duplikat-Entfernung, Null-Wert-Behandlung, Schlüssel-Mapping, Berechnungen (z.B. Deckungsbeitrag aus Umsatz und Kosten), Normalisierung und Denormalisierung für das Star-Schema.

Load (Laden)

Die transformierten Daten ins Zielsystem (Data Warehouse) schreiben. Zwei Ansätze: Full Refresh (Tabelle komplett neu laden) oder Upsert (neue Datensätze einfügen, bestehende aktualisieren). Historische Daten werden über SCD-Typen (Slowly Changing Dimensions) verwaltet.

ETL vs. ELT: Der moderne Ansatz

| Aspekt | ETL (klassisch) | ELT (modern) |

|---|---|---|

| Transformation | Vor dem Laden (separater Server) | Nach dem Laden (im DWH) |

| Performance | Begrenzt durch ETL-Server | Nutzt DWH-Compute-Power |

| Flexibilität | Schema muss vorher feststehen | Rohdaten verfügbar, Schema flexibel |

| Typisches Tool | SSIS, Informatica, Talend | dbt + Fivetran/Airbyte |

| Ideal für | On-Premise, Legacy-Systeme | Cloud DWH (Snowflake, BigQuery) |

ETL-Tools im Überblick

Azure Data Factory

Microsofts Cloud-ETL: 100+ Konnektoren, visueller Pipeline-Designer, nahtlose Integration mit Power BI und Synapse. Ideal für Microsoft-Umgebungen.

dbt (Data Build Tool)

Open-Source-Transformation-Layer: SQL-basiert, versionierbar, testbar. Der Standard im Modern Data Stack für ELT-Transformationen.

Fivetran / Airbyte

Managed Data Integration: Automatische Konnektoren für 300+ Datenquellen. Fivetran (SaaS), Airbyte (Open Source). Ideal für den Extract+Load-Teil.

Power Query (Power BI)

Für einfache ETL-Anforderungen: Visueller Editor direkt in Power BI Desktop. Geeignet für den Einstieg im Mittelstand.

Best Practices

- Incremental Loads: Nur Änderungen laden, nicht alles jedes Mal neu – spart Zeit und Kosten

- Idempotenz: Jeder ETL-Lauf muss wiederholt werden können, ohne Duplikate zu erzeugen

- Monitoring & Alerting: Automatische Benachrichtigung bei fehlgeschlagenen Jobs

- Data Lineage: Nachvollziehbar dokumentieren, woher jede Zahl kommt

- Testing: Automatisierte Tests für Datenqualität und Business-Logik

📚 Dieser Artikel ist Teil unseres Technologie-Guides: BI-Technologie Grundlagen →

ETL-Architektur planen?

Gemeinsam entwerfen wir die optimale Datenpipeline für Ihre Quellsysteme und Analyseanforderungen.

ETL-Beratung anfragen →