Liquiditätskennzahlen geben an, in welchem Maß (kurzfristige) Verbindlichkeiten nach Höhe und Fälligkeit mit flüssigen und anderen kurzfristigen Deckungsmitteln bedient werden können. Sie werden aus der Bilanz abgeleitet, indem bestimmte Vermögensposten zu bestimmten Kapitalposten in Beziehung gesetzt werden.

Typischerweise werden drei Liquiditätsgrade unterschieden, indem zunächst die Positionen Bank und Kasse beurteilt werden, dann zusätzlich die Gesamtheit der Außenstände und schließlich ergänzend das gesamte Umlaufvermögen als kurzfristig gebundenes Kapital:

Liquidität 1. Grades (Cash Ratio) = (Flüssige Mittel /Kurzfristige Verbindlichkeiten) * 100

Liquidität 2. Grades (Quick Ratio) = (Flüssige Mittel + Kurzfristige Forderungen / Kurzfristige Verbindlichkeiten) * 100

Liquidität 3. Grades (Current Ratio) = (Flüssige Mittel + Kurzfristige Forderungen + Vorräte / Kurzfristige Verbindlichkeiten) * 100

Als weitere

Kennzahl kann das Working Capital herangezogen werden. Sie gibt an, inwieweit das Umlaufvermögen (Flüssige Mittel + Kurzfristige Forderungen + Vorräte) von den kurzfristigen Verbindlichkeiten belastet wird:

Working-Capital = Umlaufvermögen – Kurzfristige Verbindlichkeiten

Dieser Wert gibt an, wie groß der Anteil der kurzfristig verfügbaren Mittel ist, der nicht zur Finanzierung der kurzfristigen Verbindlichkeiten benötigt wird, und ermöglicht damit eine Aussage über die Bonität eines Unternehmens.

Generelles Problem beim Einsatz von Liquiditätskennzahlen ist, dass sie sich als bilanzbezogene Kennziffern lediglich auf Stichtagsbestände an Vermögen und Kapital beziehen, keine Finanzströme aus langfristigen Finanzierungen, aus Verpflichtungen und Ansprüchen aus schwebenden Geschäften oder kurzfristig mobilisierbare Finanzreserven berücksichtigen und nur ein durchschnittliches Deckungsverhältnis angeben, ohne Hinweis auf genaue Fälligkeit kurzfristiger Forderungen und Verbindlichkeiten. Als Abhilfe wurde der dynamische Liquiditätsgrad eingeführt, der die Zahlungsströme (Cahflow) in Relation zu den kurzfristigen Verbindlichkeiten setzt:

Dynamischer Liquiditätsgrad = (Cashflow / kurzfristige Verbindlichkeiten) * 100nn

Berechnung

Formel: 1. Grad: Zahlungsmittel ÷ kurzfr. Verbindlichkeiten × 100. 2. Grad: (Zahlungsmittel + kurzfr. Forderungen) ÷ kurzfr. Verbindlichkeiten × 100. 3. Grad: Umlaufvermögen ÷ kurzfr. Verbindlichkeiten × 100

Einheit: Prozent

Interpretation & Bewertung

Liquiditätskennzahlen messen die Fähigkeit eines Unternehmens, seine kurzfristigen Zahlungsverpflichtungen zu erfüllen. Die drei Grade unterscheiden sich in der Fristigkeit der einbezogenen Vermögenswerte. Eine zu niedrige Liquidität gefährdet die Zahlungsfähigkeit, eine zu hohe deutet auf ineffizienten Kapitaleinsatz hin.

Praxisbeispiel

Ein IT-Dienstleister hat 200.000 € Zahlungsmittel, 800.000 € kurzfristige Forderungen und 500.000 € kurzfristige Verbindlichkeiten. Liquidität 1. Grades: 40 %. Liquidität 2. Grades: 200 %. Beide Werte sind gesund.

Benchmarks

1. Grad: 10–30 %. 2. Grad: über 100 % (Faustregel). 3. Grad: 150–200 %. Unter 100 % bei Grad 2 ist ein Warnsignal.

Weiterführende Artikel

Weiterlesen: Abschreibungsquote · Return on Invested Capital (ROIC) · Controllingsoftware

Interpretation:

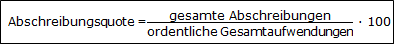

Die Abschreibungsquote gibt an, welchen Teil die bilanziellen Abschreibungen auf das

Interpretation:

Die Abschreibungsquote gibt an, welchen Teil die bilanziellen Abschreibungen auf das